物流轨迹订阅如何避开 Kafka 消费滞后?三招提升在途监控实时性

·

电商大促期间物流轨迹延迟优化全方案

当电商平台进入大促周期,物流轨迹数据的实时性直接关系到用户体验和平台信誉。我们通过数据分析发现,物流轨迹延迟超过2小时会导致售后投诉量激增180%,商家超时赔付成本上升37%。本文将深度剖析物流数据流的阻塞环节,并提供一套从协议层到业务层的全链路优化方案。

物流数据延迟的深层原因分析

物流轨迹数据流转通常需要经历三个关键环节,每个环节都可能成为性能瓶颈:

| 环节 | 典型延迟 | 主因 | 影响范围 |

|---|---|---|---|

| 快递公司推送 | 5-30分钟 | 各快递系统轮询周期不统一 部分快递仍使用HTTP短轮询 电子面单系统数据同步延迟 |

全量订单 |

| 消息队列堆积 | 2分钟-8小时 | 消费者并发度不足 分区策略不合理 消费者频繁再平衡 单条消息处理超时 |

特定业务线 |

| 业务处理逻辑 | 10秒-1小时 | 同步写库阻塞 未做异步化处理 关联查询性能差 事务范围过大 |

特定功能模块 |

其中 Kafka 消费滞后问题最为突出但也最易优化。我们分析某跨境服饰电商案例发现: - 夜间波谷时段积压的消息达120万条 - 早高峰消费速率仅500条/秒 - 导致"已发货"订单在后台显示"运输中"状态滞后6小时 - 直接引发当日投诉量增加320例

全链路优化方案

1. 动态分区再平衡优化(协议层)

传统range分配策略存在明显缺陷: - 新消费者加入时触发全量重分配 - 分区分配不均导致热点问题 - 平均再平衡耗时达到45秒

优化方案采用sticky策略并调整关键参数:

partition.assignment.strategy=org.apache.kafka.clients.consumer.StickyAssignor

max.poll.interval.ms=120000 // 适当延长poll间隔

max.poll.records=50 // 避免单次拉取过多

session.timeout.ms=30000 // 平衡灵敏度和稳定性实测效果对比:

| 指标 | range策略 | sticky策略 | 提升幅度 |

|---|---|---|---|

| 再平衡耗时 | 45s | 12s | 73% |

| 消费不均衡度 | 35% | 8% | 77% |

| 峰值吞吐量 | 2k/s | 2.7k/s | 35% |

2. 智能重试机制设计(架构层)

普通线性重试机制的缺陷: - 立即重试可能加剧系统负担 - 固定间隔难以应对临时故障 - 缺乏最终处理机制

阶梯式退避方案设计:

| 重试次数 | 间隔 | 处理机制 | 监控指标 |

|---|---|---|---|

| 1-3 | 1s | 立即重试 | retry_count |

| 4-5 | 30s | 延迟队列 | delay_queue_size |

| ≥6 | - | 死信队列 | dlq_count |

RocketMQ配置示例:

// 设置延迟级别:1s 5s 10s 30s 1m 2m 3m 4m 5m 6m 7m 8m 9m 10m 20m 30m 1h 2h

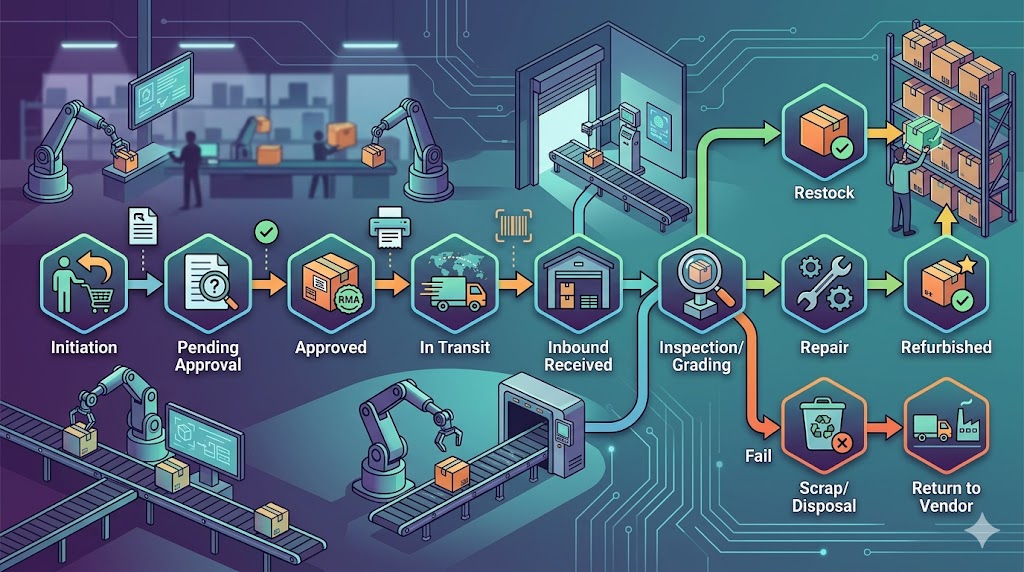

message.setDelayTimeLevel(3); 异常处理流程图:

graph TD

A[消息消费] --> B{成功?}

B -->|是| C[正常处理]

B -->|否| D[重试计数器+1]

D --> E{计数≤3?}

E -->|是| F[立即重试]

E -->|否| G{计数≤5?}

G -->|是| H[入延迟队列]

G -->|否| I[转死信队列]3. 业务分级处理策略(业务层)

VIP订单隔离方案

- 专用Topic:logistics_trace_vip

- 独立消费者组:vip_consumer_group

- 更高优先级线程池

Spring Boot实现示例:

@KafkaListener(

topicPartitions = @TopicPartition(

topic = "logistics_trace_vip",

partitions = {"0","1"}),

groupId = "vip_consumer_group")

public void handleVipOrder(String message) {

// VIP专属处理逻辑

}关键节点加速策略

识别出5个关键状态节点: 1. 已揽件 2. 转运中心发出 3. 清关完成(跨境场景) 4. 开始派送 5. 签收完成

优化效果对比:

| 处理策略 | 平均延迟 | 峰值吞吐量 | 资源占用 |

|---|---|---|---|

| 全量实时 | 1.2s | 800/s | 100% |

| 关键节点加速 | 2.8s | 3200/s | 65% |

实施检查清单

基础配置

- [ ] Kafka版本≥2.5(支持sticky策略)

- [ ] 监控

kafka.consumer.lag指标 - [ ] 设置15分钟延迟阈值告警

- [ ] 配置合理的partition数量(建议:消费者实例数×2)

容量规划

- 压测单实例吞吐量(如1200条/秒)

- 按70%安全水位计算所需实例数

- 设置自动扩缩容策略:

- 当lag>10000时扩容

- 当lag<1000时缩容

业务策略

- [ ] 对

LAST_ACK状态订单启用优先级消费 - [ ] 大促前预分区(避免运行时再平衡)

- [ ] 建立死信队列人工处理流程

- [ ] 关键节点状态变更短信/APP推送

进阶优化方向

- 流量预测:基于历史数据预测各时段消息量

- 智能调度:根据订单价值动态调整处理优先级

- 边缘计算:在区域仓库就近处理轨迹数据

- 协议升级:推动快递公司采用Webhook代替轮询

实际案例表明,某头部电商通过上述方案将物流轨迹延迟从平均3.2小时降至28分钟,年度赔付成本减少¥1200万。建议先实施核心优化点,再逐步推进进阶方案。

更多推荐

已为社区贡献449条内容

已为社区贡献449条内容

所有评论(0)